1.上下文是什么意思?

AI生成的人物和场景转头就变样,缺乏一致性?nonono,这回不一样了,康康下面的demo!游戏地图:《塞尔达传说》中的绿色田野

2.上下文章

建筑:《黑神话悟空》里的废弃寺庙

3.上下文怎么读

角色模型:《原神》里的云堇

4.上下文怎么写

无论镜头怎么晃,场景里的元素都乖乖不动,一致性满分。这一惊艳效果就来自香港大学和快手可灵的研究团队提出的全新框架——“上下文即记忆”(Context-as-Memory)。

5.上下文包括什么

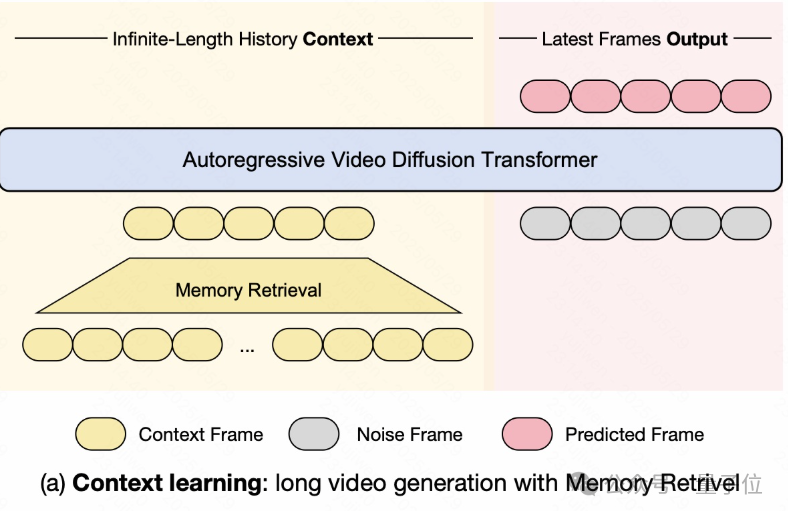

该方法直接将完整的历史上下文帧(context frames)作为记忆,并通过记忆检索高效利用相关历史帧,极大地优化了交互式长视频生成中的场景一致性他们是怎么做的?快来一起看看吧上下文记忆与记忆检索在聊新方法之前,咱们先来简单梳理一下视频生成里的两类“记忆”类型:

6.什么叫做上下文

一类是处理短期运动和行为模式的动态记忆,例如视频中的角色动画、车辆轨迹、粒子效果以及天气变化等另一类就是这篇论文针对的静态记忆,包括场景级和物体级的记忆,例如游戏地图、建筑、角色模型和物体外观明确了动态与静态记忆的区别后,我们就可以更清晰地理解本论文提出的核心思路:Context-as-Memory。

7.上下文的意思是什么

总体来看,Context-as-Memory的核心思想有以下三点:长视频生成需要长期的历史记忆:为了保持长时间的场景一致性,模型不能只依赖最近的几帧记忆检索是关键:直接使用所有历史帧成本太高,需要一个“记忆检索”模块来智能地从无限的历史上下文中筛选出真正有用的信息。

上下文记忆:通过将筛选出的上下文帧(作为记忆)直接拼接在输入中,模型可以在生成新帧时参考这些历史信息,从而实现场景的一致性。

具体来说,模型从一个无限长度的历史上下文中开始,利用一个“记忆检索”模块从中筛选出那些真正有用的、与当前生成最相关的上下文帧这些被筛选出的上下文帧随后与带噪声的待预测帧拼接在一起,作为核心的“自回归视频扩散Transformer”的输入。

模型处理这个拼接后的输入,利用历史记忆作为条件来指导去噪过程,最终生成一系列最新的预测帧通过这种方式,Context-as-Memory避免了直接处理全部历史上下文的巨大计算开销,同时也避免了仅依赖短期上下文导致场景不一致的问题,从而实现了高效且具有场景连贯性的长视频生成。

那么,模型是如何进行帧选取,从而进行记忆检索的呢?在这里,研究提出了一个不同于随机、就近选取与压缩的方法——基于摄像机轨迹搜索。

这一方法通过已知的摄像机轨迹,选择与当前生成帧可视区域高度重叠的上下文帧

评论(0)