目录:

1.英伟达高管团队

2.英伟达韩国官网

3.英伟达ceo

4.英伟达联合创始人

5.英伟达 老总

6.英伟达高层

7.英伟达个人资料

8.英伟达中国区总经理:瞄准内容创造者

9.英伟达中国区高管

10.英伟达公司ceo

1.英伟达高管团队

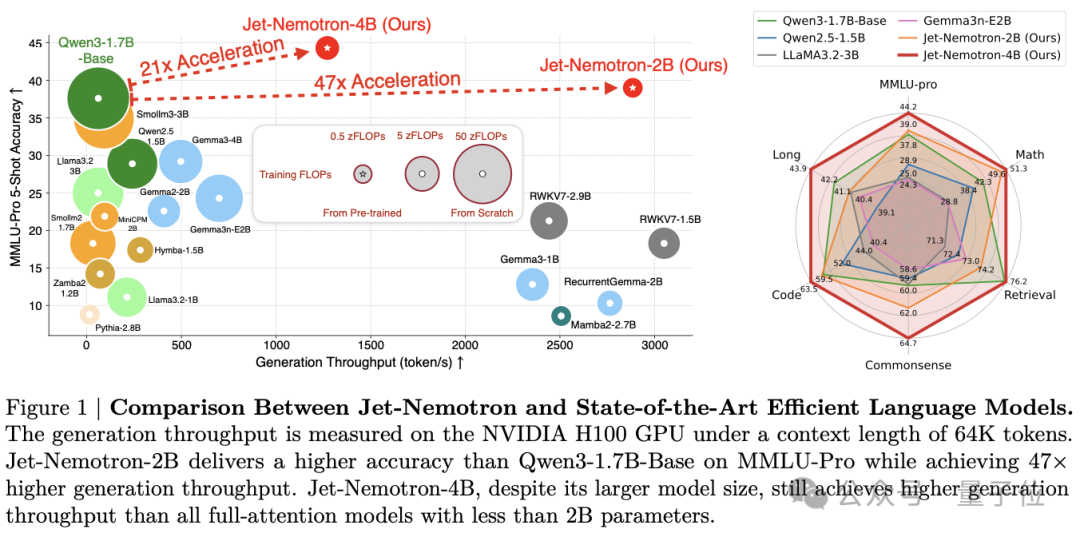

英伟达开源又放大招了!韩松团队推出了一款全新的基于后神经架构搜索的高效语言模型——Jet-Nemotron该模型在一系列基准测试中,不仅表现出与Qwen3、Qwen2.5、Gemma 3和Llama 3.2相当甚至更优的准确率,还在生成吞吐量上实现最高53.6倍加速,在预填充阶段达到6.1倍加速。

2.英伟达韩国官网

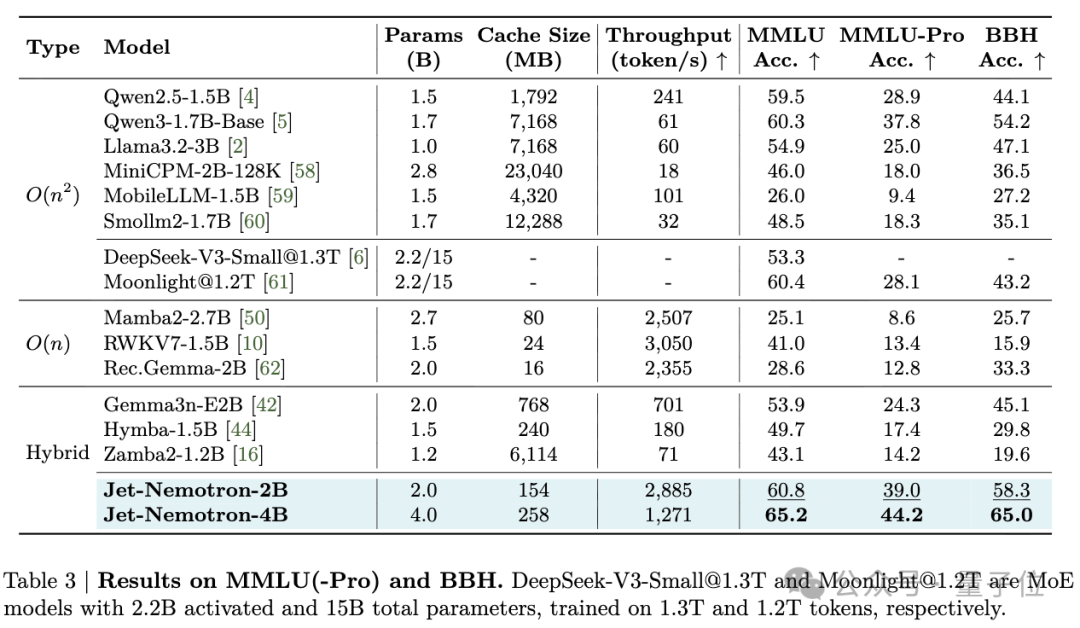

值得一提的是,在MMLU、MMLU-Pro和BBH基准上,Jet-Nemotron-2B相比Qwen3-1.7B-Base吞吐量提高了47倍,缓存大小缩小至1/47同时,它还实现了比DeepSeek-V3-Small和Moonlight(共150亿参数,22亿激活参数)更高的准确率。

3.英伟达ceo

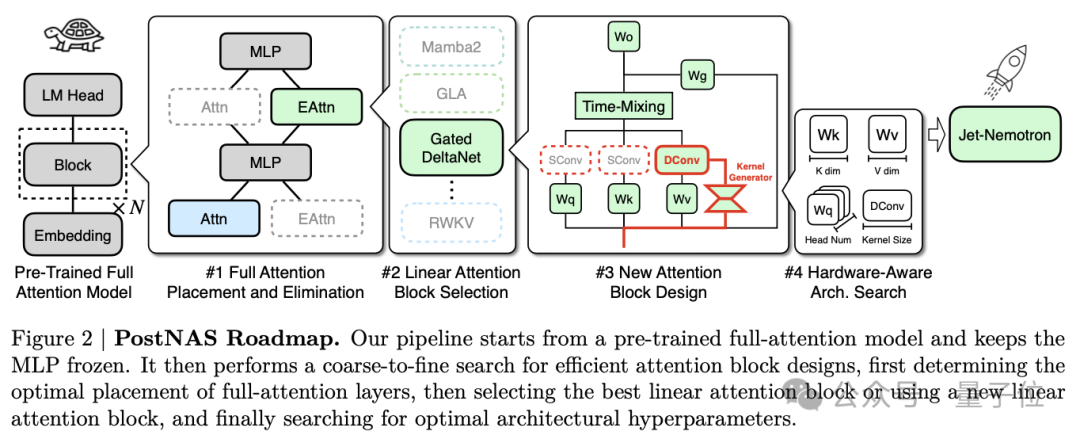

代码和预训练模型都将开源,我们先来看看Jet-Nemotron是如何构建的Jet-Nemotron:基于后神经架构搜索构建首先,Jet-Nemotron是在后神经架构搜索(Post Neural Architecture Search,PostNAS)的基础上构建的。

4.英伟达联合创始人

其中,后神经架构搜索(PostNAS)模型是一种“站在大模型肩膀上做改造”的架构搜索方法。

5.英伟达 老总

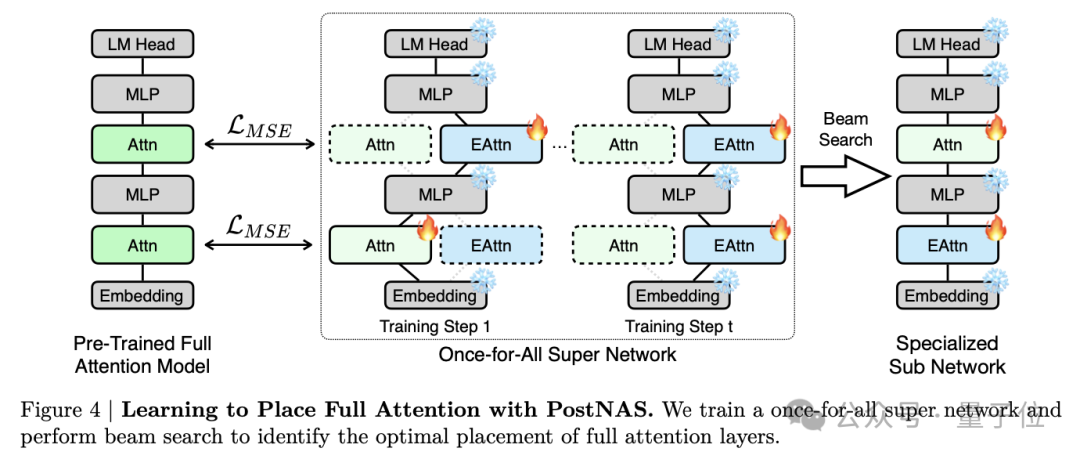

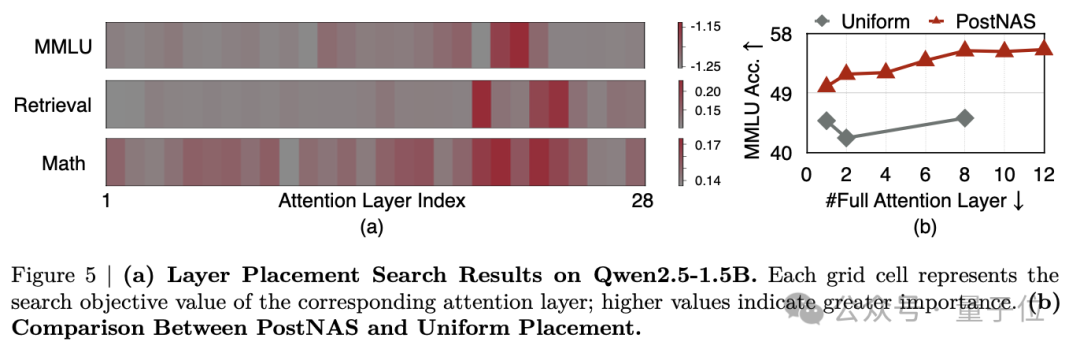

它从一个预训练的全注意力模型出发,并直接继承其多层感知机权重,且在整个过程中保持这些权重被冻结(不再更新)Jet-Nemotron就是将PostNAS通过以下4个步骤优化得到的:全注意力层的放置和消除在模型中保留少数几个全注意力层,对于在检索等高难度任务上保持高准确率至关重要。

6.英伟达高层

然而,这些层的最佳放置位置一直不明确。因此,研究团队引入了一种新方法,通过训练一个“一次性”超级网络 (once-for-all super network),自动学习应该在哪些位置使用全注意力层。

7.英伟达个人资料

实验结果表明,与常用的均匀放置策略相比,这种学习到的放置方式在MMLU基准上的准确率有显著提升。

8.英伟达中国区总经理:瞄准内容创造者

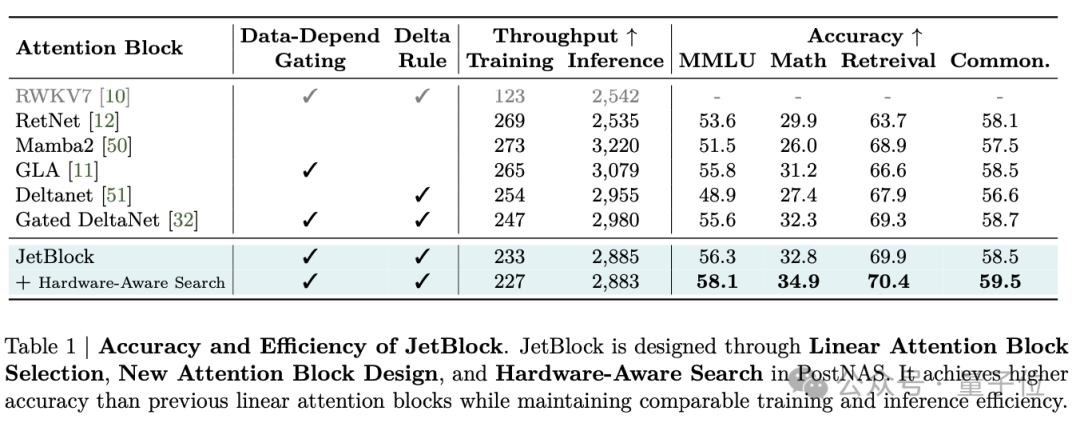

选择线性注意力模块在确定了全注意力层的放置方案后,研究团队进行注意力模块搜索,以确定最优的线性注意力模块在实验中,他们评估了6个最先进的线性注意力模块(RWKV7由于训练吞吐量过低排除在外),结果如下

9.英伟达中国区高管

由上表观察到,Gated DeltaNet实现了最优的整体准确率因此,研究团队在后续实验中都采用Gated DeltaNet设计新型注意力模块添加卷积是增强线性注意力能力的一种常用策略然而,以往的方法仅仅依赖于。

10.英伟达公司ceo

静态卷积核

评论(0)