目录:

1.gpt4.0免费

2.gpt4o

3.gpt4.0官网

4.gpt4什么东西

5.gpt4发布日期

6.gpt4omini

7.gpt40免费版安装

8.gpt4o开源了吗

9.gpt4参数量

10.gpt4omini和gpt4o什么区别

1.gpt4.0免费

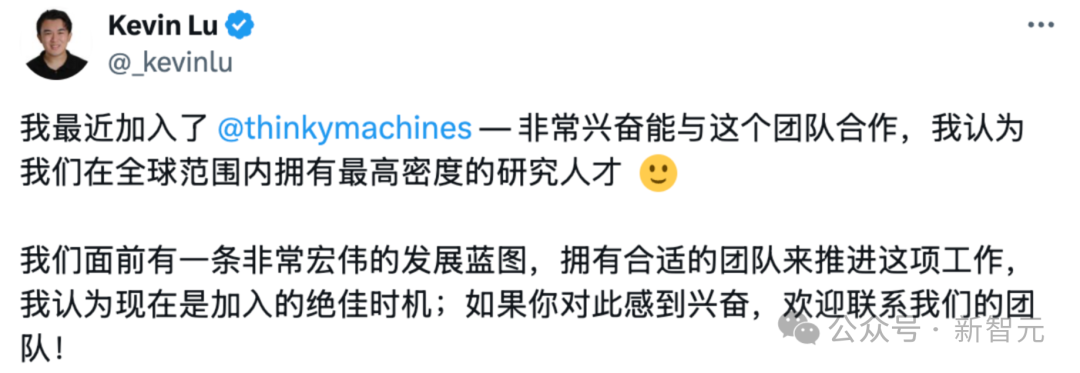

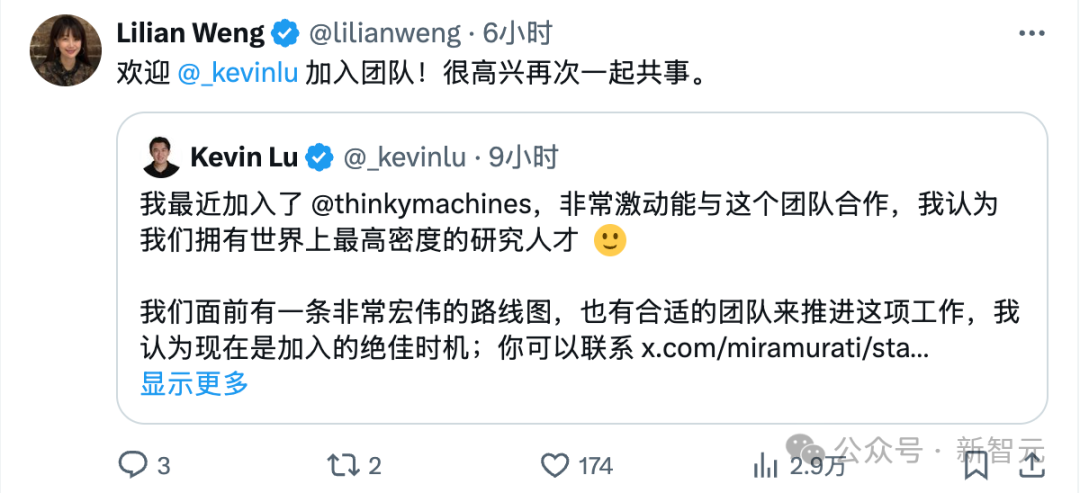

刚刚,OpenAI又离职一名华人大佬。前OpenAI研究员Kevin Lu宣布加入AI新创Thinking Machines Lab。

2.gpt4o

Kevin Lu主导了GPT-4o mini的发布,并参与o*-mini、o3等模型工作Thinking Machines Lab由前OpenAI CTO Mira Murati创立的2025年7月,公司创历史完成。

3.gpt4.0官网

约20亿美元的超大额早期融资(a16z领投),估值约120亿美元。随后团队核心成员在社交平台上互动表示欢迎。

4.gpt4什么东西

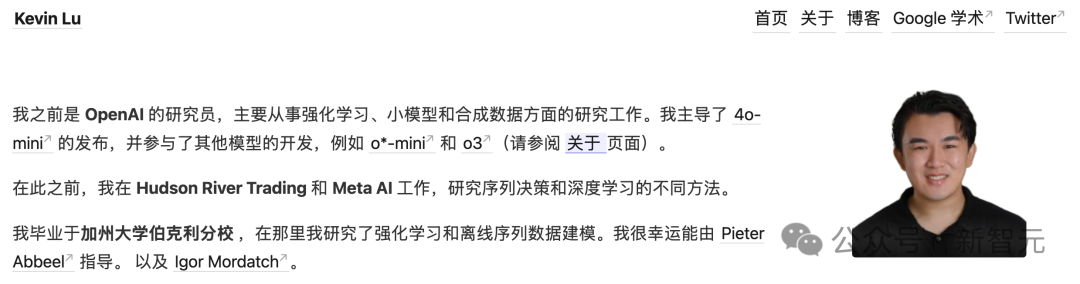

Kevin Lu是强化学习与小模型方向的研究者,本科就读于加州大学伯克利分校,在OpenAI期间专注强化学习、Small Models与合成数据。

5.gpt4发布日期

加入Thinking Machines之前还在Hudson River Trading、MetaAI从事序列决策与深度学习研究真正推动AI进步的是互联网Kevin Lu在小模型与合成数据上的实践经验,有助于Thinking Machines缩短从论文到用户价值的距离。

6.gpt4omini

尤其是他7月的一篇博客非常出圈:真正推动AI进步是互联网。深入浅出的讲明白一个事情:与其反复抠架构,不如扩大、丰富、贴近现实的数据来源(如互联网)与数据消耗方式,否则模型始终「见得少、懂得少」。

7.gpt40免费版安装

博客地址:https://kevinlu.ai/the-only-important-technology-is-the-internet以下为博客的部分截取翻译:虽然AI的进步常被归功于一些里程碑论文——比如Transformers、RNNs、Diffusion——但这忽略了AI最根本的瓶颈:数据。

8.gpt4o开源了吗

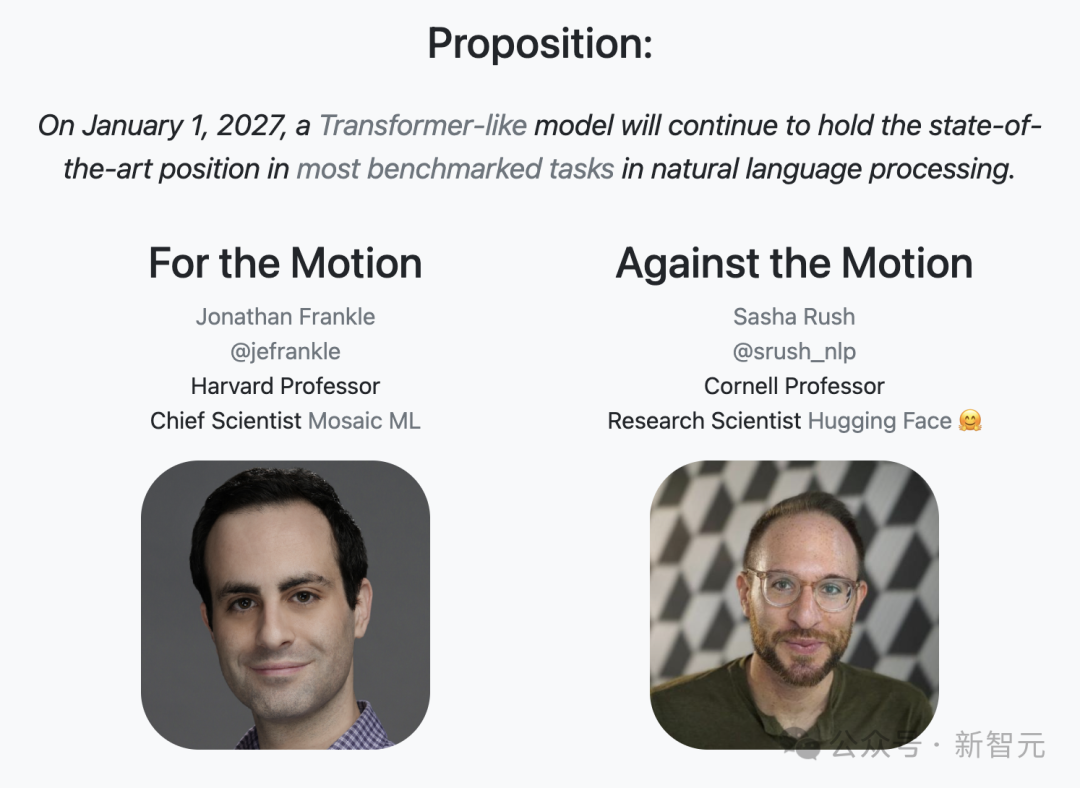

那么,「好数据」究竟意味着什么?如果我们真想推进AI,与其研究深度学习优化,不如研究「互联网」互联网才是让我们的AI模型实现规模化扩展的那项关键技术· Transformers是一种「分散注意力」受架构创新带来的快速进展启发(5年间从AlexNet到Transformer),许多研究者一直在寻找更好的架构先验,寄望于设计出「优于Transformer」的新架构。

9.gpt4参数量

事实上,Transformer之后确实出现了一些更好的架构;但为什么自GPT-4以来,我们很难「切身感到」这种改进?

10.gpt4omini和gpt4o什么区别

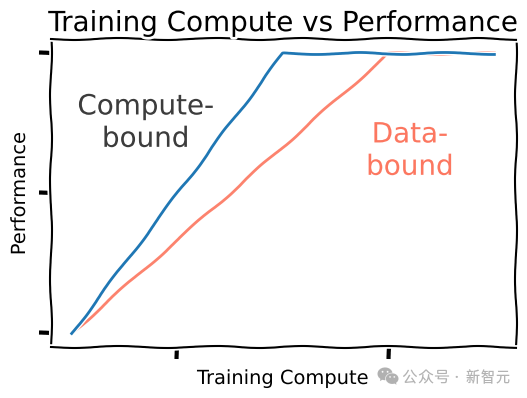

· 范式更迭算力受限(compute-bound)。曾经,方法随算力扩展,更高效的方法就更好。真正重要的是把数据尽可能高效地塞进模型里;这些方法不仅效果更好,而且似乎「越大越灵」。

然后,数据受限(data-bound)研究模型架构当然不是没用社区在Transformer之后开发出了更好的方法,比如SSMs与Mamba等但它们并非「免费的胜利」:在给定训练算力下,训练一个Transformer往往能得到更优性能。

但数据绑定的范式是自由的:反正各种方法最终都差不多!因此应选择推理阶段更优的方法,可能是某种「次二次注意力变体」(subquadratic attention variant)这些方法很可能会再度走到台前。

· 研究者该做什么?设想我们不只关心推理(可以理解为「产品」),而是关心渐近性能(可以理解为朝着AGI迈进):显然,只优化架构是错的调整Q-function轨迹裁剪也不对手工打造新数据集无法扩展花哨的「时间高斯探索」(new temporal Gaussian exploration method)也大概率不具扩展性。

社区的许多成员已经达成共识:应研究新的「数据消费」方式目前两大主流范式是:(1)下一个token预测(NTP)与(2)强化学习(RL)(显然,我们在「新范式」上并没取得太多突破)AI的本质就是「消耗数据」。

目前AI领域里程碑工作本质上是在开辟数据消耗

评论(0)